La plupart des systèmes de gouvernance d’entreprise ont été conçus pour un monde où les logiciels se comportent de manière prévisible. Vous définissez une règle. Le système l’applique. Si l’entrée correspond au schéma défini, la règle s’exécute. Ce système a fonctionné pendant des décennies, car le logiciel traditionnel est déterministe : une même entrée produit toujours la même sortie.

Les agents IA ont fait voler cette logique en éclats. Et les systèmes de gouvernance pensés pour l’ancien paradigme montrent déjà leurs limites dans le nouveau.

Les moteurs de règles statiques, les filtres de prompts et les processus de revue manuelle partagent une même limite structurelle : ils sont incapables de comprendre l’intention. Ils ne savent pas interpréter le contexte. Et ils sont totalement dépassés face à des agents qui génèrent chaque heure des milliers d'interactions sémantiquement uniques.

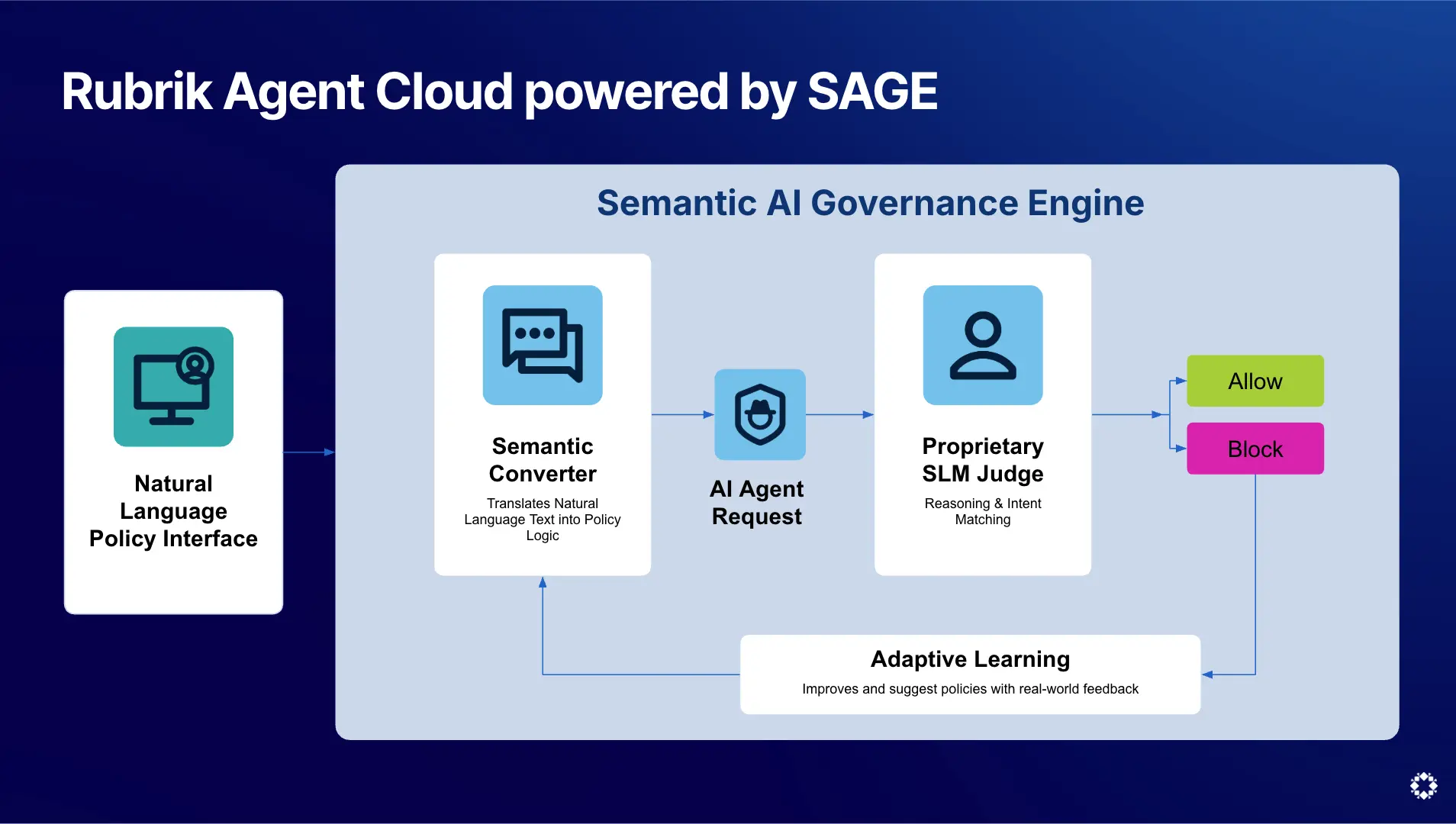

C’est précisément pour répondre à ce défi que Rubrik a développé SAGE, le Semantic AI Governance Engine. SAGE représente une approche fondamentalement différente de la gouvernance des agents, pensée spécifiquement pour la réalité non déterministe et axée sur le langage des systèmes agentiques.

Gouvernance sémantique : comprendre ce qui se joue vraiment

Prenons une politique d’entreprise simple : « Ne pas fournir de conseils financiers aux clients ». Dans un système basé sur des règles, vous implémentez cette politique via une détection de mots-clés. Vous bloquez les réponses contenant « investir », « actions », « portefeuille » ou « planification financière ». Or, un agent qui aide un client à comprendre sa facture pourrait utiliser le mot « solde ». Et un agent de support qui explique des modalités de paiement peut légitimement parler des « intérêts » à verser. Résultat : une réponse tout à fait normale est bloquée car la règle ne comprend pas le contexte.

Regardons maintenant l’effet inverse. Un prompt habile pourrait amener un agent à fournir des recommandations d’investissement détaillées, et ce sans jamais utiliser un des mots-clés sensibles. L’agent pourrait dire « Compte tenu des conditions actuelles du marché, vous pourriez envisager de renforcer votre exposition au secteur technologique », sans déclencher le moindre filtre. Il y a bel et bien infraction à la politique, mais la règle n’est pas activée.

SAGE ne cherche pas des mots-clés… car il comprend le sens. Lorsqu’une organisation formule une politique en langage naturel (« Ne fournissez pas de conseils financiers »), SAGE en interprète l’intention sémantique et la convertit en une logique exécutable par la machine. Il reconnaît qu’une réponse évoquant une stratégie d’investissement constitue bel et bien un conseil financier, même sans utiliser le mot « financier ». Et il sait tout autant qu’expliquer le solde d’une facture ne relève pas du conseil financier, même si la réponse parle d’argent.

Cette nuance est déterminante à l’échelle de l’entreprise. Les organisations qui déploient des dizaines, voire des centaines d’agents dans le support client, les opérations internes, les workflows de développement ou l’analyse de données ne peuvent pas ajuster manuellement des listes de mots-clés pour chaque type d’interaction. La diversité des réponses produites par les agents est trop large, les cas ambigus trop nombreux, et le langage trop mouvant pour qu’un tel modèle puisse suivre.

Gros plan sur l’architecture de SAGE

SAGE repose sur trois capacités essentielles, conçues pour fonctionner en synergie et offrir une gouvernance réellement adaptative.

Création de politiques en langage naturel – Avec SAGE, les organisations définissent leurs politiques de gouvernance directement en langage courant. Inutile de maîtriser des syntaxes complexes ou des modèles fondés sur des expressions régulières (regex). Les équipes de sécurité décrivent simplement ce qu’elles souhaitent empêcher ou encadrer, et SAGE analyse alors ces formulations et en interprète l’intention sous-jacente.

Interprétation sémantique des politiques – Une fois les politiques exprimées en langage naturel, SAGE les traduit en une logique exécutable. Cette étape ne se limite pas à comprendre les mots : elle vise à saisir le sens profond, tant de la politique que de l’interaction évaluée. Cette capacité repose sur un Small Language Model (SLM) propriétaire, spécifiquement conçu pour les tâches de gouvernance.

Amélioration adaptative des politiques – SAGE ne se contente pas d’appliquer les politiques : il les analyse en continu. Lorsque la formulation d’une politique est ambiguë, incomplète ou trop générale, SAGE recommande des améliorations pour renforcer sa précision. Par exemple, si une organisation définit une politique telle que « Ne pas donner de conseils financiers », SAGE peut suggérer de préciser le périmètre : Faut-il inclure les recommandations d’investissement ? Les conseils fiscaux ? La planification financière personnelle ? Cette boucle de feedback permet aux politiques de gagner en clarté, en cohérence et en efficacité au fil du temps.

L’importance d’un SLM conçu pour la gouvernance

Pourquoi ne pas utiliser un LLM généraliste pour faire appliquer des politiques de gouvernance ? La réponse tient en trois mots : latence, précision, coût.

Le SLM propriétaire de SAGE est optimisé spécifiquement pour les tâches de gouvernance. Lors des tests de performance, il a démontré une précision supérieure à celle de GPT-5.2 dans la détection des violations de politiques, tout en étant environ cinq fois plus rapide. Pour un système qui évalue chaque interaction d’un agent en temps réel, réduire cette latence fait toute la différence entre une gouvernance qui fonctionne en production… et une gouvernance qui devient un point de blocage inacceptable.

Les modèles généralistes embarquent un overhead que la gouvernance n’a pas besoin de supporter. Le SLM de SAGE est léger, rapide et conçu pour un seul objectif : comprendre si une interaction contrevient, ou non, à l’intention d’une politique.

Quand la surveillance ne suffit plus : place à la compréhension

Le changement de paradigme actuel reflète ce qui s’est produit dans la cybersécurité. Les premiers pare-feu reposaient sur des règles statiques. Ils se limitaient à bloquer des ports ou des adresses IP identifiées. Les plateformes de sécurité de nouvelle génération, elles, s’appuient sur l’IA pour analyser l’intention sous-jacente au trafic, les comportements utilisateurs et les flux de données. Cette même transition est désormais à l’œuvre dans la gouvernance des agents.

SAGE représente précisément cette nouvelle génération pour l’écosystème agentique. C’est le moteur central qui orchestre la couche de gouvernance de Rubrik Agent Cloud. Et c’est ce qui fait la différence entre une gouvernance qui entrave des actions légitimes et une gouvernance qui comprend réellement ce qui doit – ou ne doit pas – se produire.

Dans la deuxième partie de cette analyse, nous décortiquerons l’architecture technique de SAGE : comment le SLM évalue les interactions, comment l’application des politiques s’intègre au runtime des agents, et comment la gouvernance adaptative crée une boucle d’amélioration continue. Pour les architectes sécurité et les ingénieurs IA qui conçoivent des infrastructures d’agents, c’est là que se situent les véritables éléments techniques.

Explorez SAGE et Rubrik Agent Cloud en écrivant à ai-team@rubrik.com.