Die meisten Governance‑Systeme im Enterprise‑Bereich wurden für eine Welt entwickelt, in der sich Software vorhersehbar verhält. Man schreibt eine Regel. Das System befolgt sie. Wenn die Eingabe mit dem Muster übereinstimmt, wird die Regel ausgelöst. Das hat jahrzehntelang funktioniert, weil herkömmliche Software deterministisch ist: Dieselbe Eingabe erzeugt immer dieselbe Ausgabe.

KI-Agenten haben diese Annahme auf den Kopf gestellt und die für die alte Welt konzipierten Governance-Systeme versagen schon heute in der neuen Welt.

Statische Regel-Engines, Prompt-Filter und manuelle Überprüfungsprozesse leiden unter einer grundlegenden Einschränkung: Sie können keine Absicht verstehen. Sie können keinen Kontext interpretieren. Und sie können nicht mit Agenten mithalten, die Tausende von semantisch eindeutigen Interaktionen pro Stunde erzeugen.

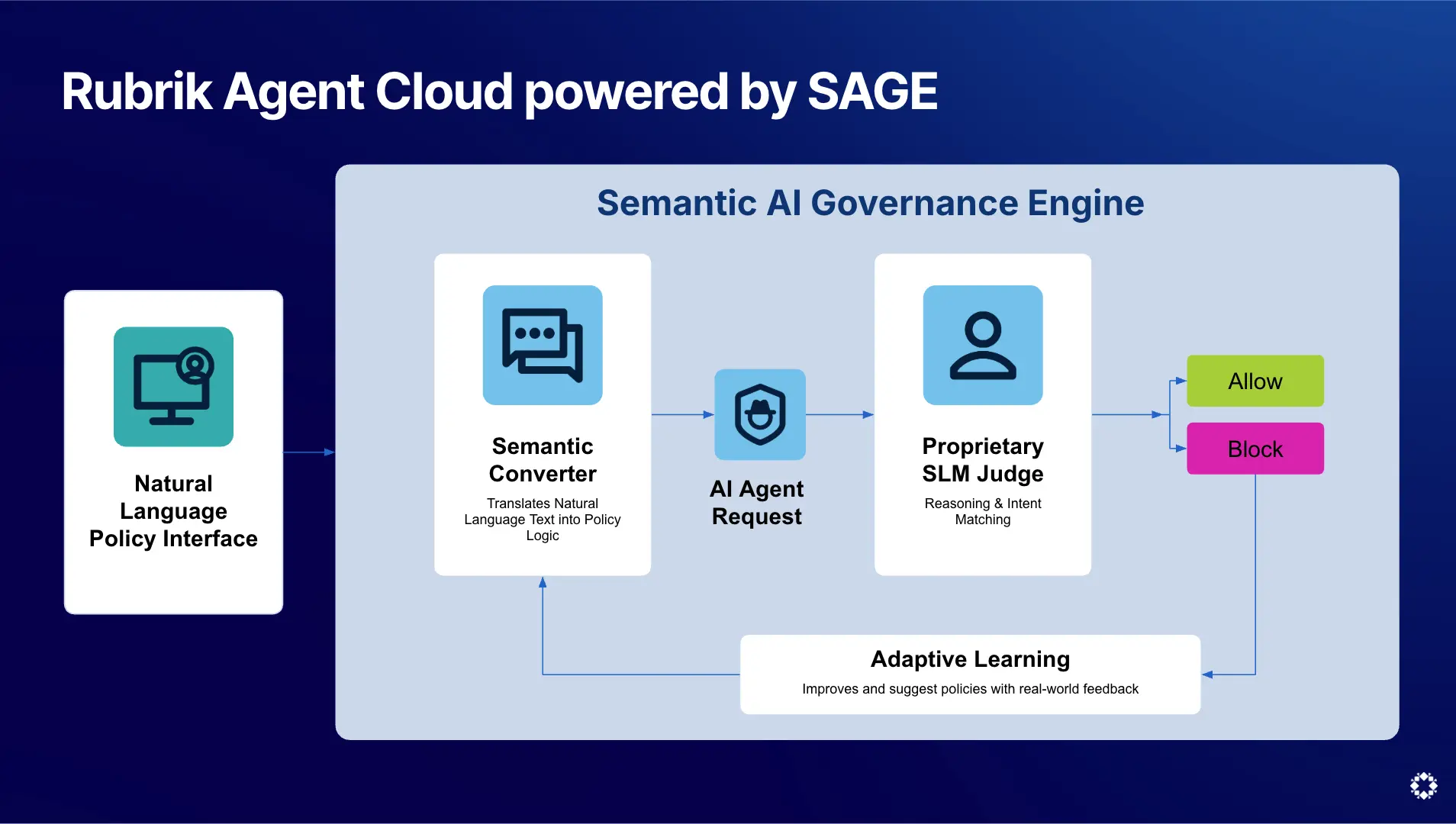

Deshalb hat Rubrik SAGE entwickelt – die Semantic AI Governance Engine. SAGE steht für einen grundlegend neuen Ansatz bei der Steuerung von Agenten – speziell entwickelt für die nicht-deterministische, sprachgesteuerte Realität agentischer Systeme.

Was semantische Governance wirklich bedeutet

Betrachten wir eine simple Unternehmensrichtlinie wie diese: „Erteilen Sie keine Finanzberatung gegenüber Kunden.“ In einem regelbasierten System würden Sie dies über Schlüsselwortfilter implementieren. Antworten, die Wörter wie „investieren“, „Aktie“, „Portfolio“ oder „Finanzplanung“ enthalten, würden blockiert. Das Problem: Ein Mitarbeiter, der einem Kunden eine Rechnung erklärt, verwendet dabei möglicherweise das Wort „Saldo“ oder ein Supportmitarbeiter, der Zahlungsbedingungen erläutert, könnte auf „Zinsen“ verweisen. In diesen Fällen würde eine völlig legitime Antwort blockiert, weil der Regel der Kontext fehlt.

Betrachten wir nun den umgekehrten Fall. Mit einem geschickt formulierten Prompt könnte ein Agent umfassende Anlageempfehlungen geben, ohne ein einziges verbotenes Schlüsselwort zu verwenden. Der Agent könnte beispielsweise sagen: „Auf Basis der aktuellen Marktlage sollten Sie erwägen, Ihre Exposure im Technologiesektor zu erhöhen“. In diesem Fall würde kein einziger Schlüsselwortfilter ausgelöst. Es wird gegen die Richtlinie verstoßen, aber die Regel greift nicht.

SAGE gleicht keine Schlüsselwörter ab, sondern versteht den Sinn. Wenn ein Unternehmen eine Richtlinie in natürlicher Sprache definiert („Keine Finanzberatung erteilen“), interpretiert SAGE die semantische Absicht dieser Richtlinie und übersetzt sie in durchsetzbare Maschinenlogik. SAGE erkennt, dass eine Antwort, die eine Anlagestrategie beschreibt, eine Finanzberatung darstellt, selbst wenn das Wort „finanziell“ nie vorkommt. SAGE versteht auch, dass die Erläuterung eines Rechnungssaldos keine Finanzberatung ist, auch wenn über Geld gesprochen wird.

Für skalierte Unternehmensumgebungen ist diese Unterscheidung sehr wichtig. Unternehmen, die Dutzende oder Hunderte von Agenten in den Bereichen Kundensupport, interne Abläufe, Entwicklungsworkflows und Datenanalyse einsetzen, können nicht für jedes Interaktionsmuster manuell Schlüsselwortlisten pflegen. Die Bandbreite der Agenten-Antworten ist schlicht zu groß, es gibt zu viele Grenzfälle und die Sprache ist zu dynamisch.

Wie SAGE aufgebaut ist

SAGE stützt sich auf drei Kernfunktionen, die zusammen adaptive Governance ermöglichen.

Erstellung von Richtlinien in natürlicher Sprache: Unternehmen definieren Governance-Richtlinien in natürlicher Sprache, nicht über Regex-Muster oder eine Regelsyntax. Sicherheitsteams beschreiben, was verhindert werden soll, und SAGE interpretiert die Absicht hinter diesen Beschreibungen.

Semantische Richtlinienauslegung: Da SAGE die Bedeutung – und nicht nur einzelne Wörter – der Richtlinie und der zu bewertenden Agenteninteraktion versteht, kann die Lösung natürlichsprachliche Richtlinien in durchsetzbare Logik übersetzen. Dies wird durch ein proprietäres Small Language Model (SLM) unterstützt, das speziell für Governance-Aufgaben entwickelt wurde.

Adaptive Richtlinienverbesserung: SAGE setzt Richtlinien nicht nur durch, sondern analysiert sie auch. Wenn eine Richtliniendefinition unklar oder unvollständig ist, empfiehlt SAGE Verbesserungen. Beispielsweise könnte SAGE bei einer Richtlinie wie „Keine Finanzberatung geben“ empfehlen, den Geltungsbereich zu präzisieren: Soll dies auch Anlageempfehlungen, Steuerberatung oder Finanzplanung umfassen? Durch diese Feedback-Schleife werden Richtlinien im Laufe der Zeit immer präziser.

Warum Governance ein eigenes SLM braucht

Warum verwendet SAGE kein generisches LLM für die Durchsetzung von Richtlinien? Die Antwort liegt in der Latenzzeit, der Genauigkeit und den Kosten.

Das proprietäre SAGE-SLM ist speziell für Governance-Aufgaben optimiert. In Benchmark-Tests erreichte es bei der Erkennung von Richtlinienverstößen eine höhere Genauigkeit als GPT-5.2 und lief dabei etwa fünfmal schneller. Für ein System, das jede Agenteninteraktion in Echtzeit auswertet, bedeutet eine geringere Latenz den Unterschied zwischen praxistauglicher Governance und einem inakzeptablen Produktionsengpass.

Generische Modelle sind unnötig groß und Governance verlangt Fokus – kein Modell, das für alles optimiert ist. Das SAGE-SLM ist kompakt, schnell und für eine einzige Aufgabe konzipiert: zu verstehen, ob eine Agenteninteraktion die Absicht einer Richtlinie verletzt.

Der Übergang von Kontrolle zum Verstehen

Der branchenweite Wandel, den wir hier beobachten, spiegelt die Entwicklung im Bereich der Cyber-Sicherheit wider. Frühe Firewalls waren regelbasiert. Sie blockierten bestimmte Ports und IP-Adressen. Moderne Sicherheitsplattformen nutzen KI, um die Absicht hinter dem Netzwerkverkehr, dem Benutzerverhalten und den Datenbewegungen zu verstehen. Die gleiche Entwicklung vollzieht sich nun auch bei der Steuerung agentischer Systeme.

SAGE ist die Antwort auf diese Entwicklung in der Welt der Agenten. SAGE ist die zentrale Engine, die die Governance-Ebene der Rubrik Agent Cloud antreibt. Damit verkörpert SAGE den Unterschied zwischen Governance, die legitimes Agenten-Verhalten blockiert, und Governance, die richtig einordnet, was erlaubt ist und was nicht.

Im zweiten Teil dieser Diskussion gehen wir näher auf die technische Architektur von SAGE ein und zeigen, wie das SLM Interaktionen auswertet, wie die Durchsetzung von Richtlinien in die Laufzeitumgebung der Agenten integriert ist und wie adaptive Governance einen kontinuierlichen Lern- und Optimierungsprozess ermöglicht. Hier finden Sicherheitsarchitekten und KI-Ingenieure, die Agenten-Infrastrukturen entwickeln, die technischen Details, die in der Praxis entscheidend sind.

Erfahren Sie mehr über SAGE und Rubrik Agent Cloud unter ai-team@rubrik.com.